워드프레스로 블로그를 운영하면서, 콘텐츠의 보호와 관리에 대한 고민은 필수적입니다.

특히, AI 크롤러들이 웹사이트나 블로그의 데이터를 가져가서 학습에 활용하고 있는데, 이러한 AI 크롤러들은 때로는 저작권 침해, 개인정보 유출, 서버 과부하 등의 문제를 일으킬 수 있습니다.

따라서, 이번 글에서는 robots.txt 파일을 활용하여 AI 크롤러를 차단하는 방법에 대해 상세히 알아보겠습니다.

1. robots.txt 파일이란?

robots.txt 파일은 웹사이트 또는 블로그에 방문하는 검색 엔진 크롤러(bot) 들이 사이트의 어느 부분을 크롤링(수집)할 수 있고, 어디는 수집하면 안 되는지를 알려주는 역할을 합니다.

예를 들어, 구글이나 네이버와 같은 검색 엔진은 웹사이트 및 블로그를 방문하여 콘텐츠를 분석하고 색인에 등록하는데, robots.txt 파일에 특정 페이지나 디렉터리를 크롤링하지 못하도록 제한할 수 있습니다.

구글, 네이버, 빙(Bing) 같은 검색 엔진 크롤러는 웹사이트의 트래픽을 증가시키고 검색 노출을 도와주므로 당연히 차단하지 않는 것이 좋습니다.

다만, AI 크롤러는 우리가 작성한 콘텐츠만 수집해 가져가고, 우리의 웹사이트나 블로그에 전혀 도움을 주지 않기에, 차단하는 것이 마땅하지 않나 싶습니다.

그리고 robots.txt는 크롤러에게 “우리 사이트를 크롤링하지 마세요“라고 요청하는 역할로, 악성 크롤러는 robots.txt를 무시하고 모든 콘텐츠를 수집할 수도 있으니, robots.txt 설정으로 100% 안전하다고는 할 수 없습니다.

2. AI 크롤러 차단이 필요한 이유

AI 크롤러가 웹사이트 및 블로그의 콘텐츠를 가져가는 것은, AI의 발전 그리고 AI를 이용하는 사용자들에게는 아주 큰 도움이 되겠습니다.

그러나 정성껏 웹사이트 또는 블로그를 운영해온 운영자에 대해 아무런 도움이 되지 않고, 오히려 아래와 같은 피해를 가져다주고 있습니다.

2-1. 콘텐츠 무단 사용

블로그에 양질의 콘텐츠를 작성하면서, 방문유입을 통해 애드센스 또는 기타 광고수입을 얻는 것이 대부분 블로그 운영자들의 주된 목적이 되겠으며, 블로그의 콘텐츠는 우리가 힘겹게 만들어낸 창작물이 되겠습니다.

하지만, AI 크롤러는 블로그 콘텐츠만 가져가서 AI 모델 학습에 활용할 뿐, 전혀 블로그에 방문유입을 일으켜주지 않습니다.

AI가 제공하는 정보들이 보다 정확해져가면서, AI 이용자가 늘어나게 될 것이고, 반대로 블로그에로의 유입도 줄어든다는 것이겠습니다.

따라서 우리의 콘텐츠를 무단으로 사용하면서, 우리한테 피해를 가져다주는 AI 크롤러를 차단하는 것이 마땅하다고 생각합니다.

2-2. 트래픽 낭비 방지

AI 기술이 발전하면서 너도나도 AI 시스템 개발에 참여하고 있는데, 이는 AI 크롤러도 대량으로 늘어나고 있다는 것이고, 우리의 웹사이트나 블로그를 크롤링하는 AI 크롤러가 많아져가고 있다는 것입니다.

과도한 크롤링은 서버 부하를 증가시키고, 사이트 속도 저하를 초래할 수 있기에, 블로그에 전혀 도움이 되지 않는 AI 크롤러의 크롤링은 트래픽 낭비뿐이어서 차단해주는 것이 마땅하겠습니다.

2-3. 검색 엔진 최적화(SEO) 유지

AI 크롤러가 웹사이트 및 블로그의 콘텐츠를 가져가면, 검색 엔진에서 콘텐츠가 중복된 것으로 인식될 가능성이 있기에 SEO에 악영향을 미칠 수도 있습니다.

따라서 AI 크롤러의 크롤링은 차단해주는 것이 마땅하겠습니다.

3. 어떤 AI 크롤러들이 있는가?

AI 크롤러를 모두 찾아내어 차단한다는 것은 불가능에 가까우며, 가능한 알고 있는 AI 크롤러들을 하나하나 차단하는 방법밖에 없겠습니다.

우리가 참고할 만한 것이 바로, 타 사이트에서 차단하고 있는 AI 크롤러를 참고하는 것이겠습니다.

3-1. 사이트에서 차단하고 있는 AI 크롤러들

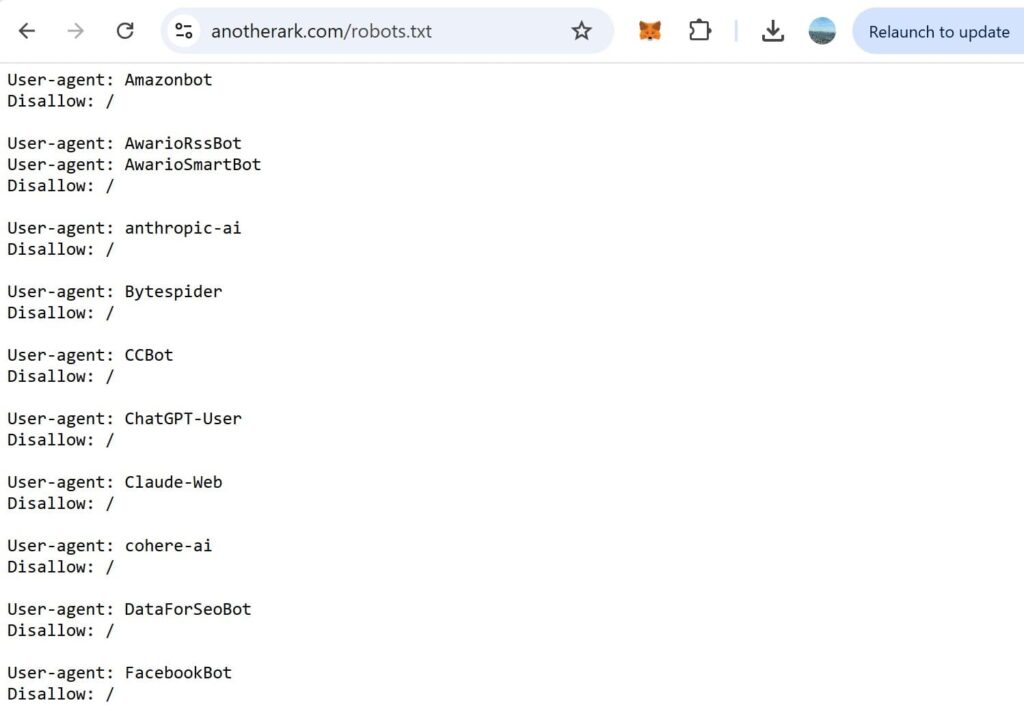

웹사이트의 robots.txt 파일은 누구나 확인이 가능하며, 웹주소 뒤에 /robots.txt을 입력하여 간단하게 확인할 수 있습니다.

참고로 아래 사이트들에서는 AI 크롤러를 차단하고 있으니, 참고해볼만 하겠습니다.

인스타그램

https://www.instagram.com/robots.txt

페북

https://www.facebook.com/robots.txt

아마존

https://www.amazon.com/robots.txt

BBC

https://www.bbc.com/robots.txt

The New York Times

https://www.nytimes.com/robots.txt

3-2. 알려져 있는 AI 크롤러들

| 업체 | AI 크롤러 | 업체 | AI 크롤러 |

| Ahrefs | AhrefsBot | Google-Extended | |

| Amazon | Amazonbot | Neeva | NeevaAI |

| Apple | Applebot | Omgili | omgilibot |

| Baidu | Baiduspider | OpenAI | GPTBot |

| Bing (Microsoft) | Bingbot | Perplexity AI | PerplexityBot |

| Cohort AI | CohortBot | Pinterestbot | |

| Common Crawl | CCBot | Seekr | SeekrBot |

| Diffbot | Diffbot | Twitterbot | |

| DuckDuckGo | DuckDuckBot | Yandex | YandexBot |

| facebookexternalhit | You.com | YouBot |

위 리스트에 있는 것들이 AI 크롤러들이 되겠으며, 모두 다 차단하고 싶지만 아래와 같이 검색엔진의 크롤러와 동시에 사용하는 경우도 있기에, 차단에 앞서 잘 생각해보셔야 하겠습니다.

예를 들어 구글검색의 크롤러와 구글 AI의 크롤러는 서로 다르기에, 구글 AI의 크롤러를 차단하더라도 구글의 검색노출에 전혀 영향이 없겠습니다.

Microsoft Bing의 크롤러 Bingbot은 검색 엔진 크롤링과 AI 데이터 수집을 동시에 수행하고 있기에, Bingbot을 차단할 경우 블로그의 콘텐츠가 Bing 검색에도 노출이 되지 않는 문제가 발생하겠습니다.

이와 같이 검색엔진의 크롤러와 AI의 크롤러가 동일한 업체는 아래와 같습니다.

Apple: Applebot

러시아의 검색 엔진인 Yandex: YandexBot

중국의 검색 엔진인 Baidu: Baiduspider

DuckDuckGo: DuckDuckBot

4. robots.txt 파일 설정 예제

지금 보시계시는 이 블로그의 robots.txt 파일은 아래 링크를 통해 확인할 수 있습니다.

https://anotherark.com/robots.txt

아직 상당수의 AI 크롤러를 정리하지 못한 상태이며, 차츰차츰 추가할 예정입니다.

그리고 robots.txt 파일을 수정했을 경우, 제대로 수정이 되었는지 확인도 필요하겠습니다.

확인하는 방법은 아래 두가지가 있겠습니다.

하나는 블로그 주소 뒤에 /robots.txt를 입력하여, 제대로 변경되었는지 확인하는 것입니다.

또하나는 구글 서치 콘솔->설정->크롤링에서 robots.txt 내용이 제대로 변경되었는지 확인할 수 있겠습니다.

robots.txt 파일 설정에 관한 상세한 방법은 아래 글에서 확인할 수 있습니다.

5. 마무리

AI의 발전이 인류에게 도움이 되는 것인지 재난을 가져다주는 것인지, 각각 견해가 다를 수 있겠지만, 혹시나 미연의 방지를 위해 무언가 조치를 해두는 것이 필요하지 않나 싶습니다.

인터넷 상의 모든 정보가 AI에 의해 통제된다는 것은 결코 좋은 결말이 보이지 않겠습니다.

너무 크게 멀리 바라보지 않더라도, AI가 우리의 웹사이트나 블로그의 데이터를 가져가서 학습에 활용하여, 반대로 콘텐츠를 제작한 우리에게 피해를 가져다주는 것 정도는 최대한 막아봐야 하지 않나 싶습니다.

혹시 이 글에서 언급되지 않은 AI 크롤러가 있다면, 댓글로 남겨주시면 추가하도록 하겠습니다.

AI 크롤러의 크롤링을 차단하는 다른 방법들은 아래 글에서 확인할 수 있습니다.

댓글